(articolo di Salvatore Borghese, da VicenzaPiù Viva n. 305, sul web per gli abbonati tutti i numeri, ndr)

“Intelligenza artificiale” (AI) è un’etichetta comoda, ma molto (forse troppo) ampia. Dentro questa etichetta ci sono software che riconoscono volti, algoritmi che ottimizzano rotte logistiche, sistemi che suggeriscono una diagnosi medica e chatbot capaci di scrivere, tradurre, riassumere e perfino programmare. In molti casi il motore dell’AI è il cosiddetto “machine learning”, un meccanismo che si basa su un numero immenso di dati per individuare gli schemi e le regolarità e riprodurle per adattarsi alle richieste degli utenti.

Quando i dati sono linguistici – testi, dialoghi, documenti – arriva quella che possiamo chiamare “language learning machine”: un modello che apprende come le frasi tendono a susseguirsi e genera risposte automatizzate. Funziona spesso in modo sorprendente, ma resta fallibile: può inventare dettagli plausibili (le cosiddette “allucinazioni”) e riflette i limiti dei dati e delle istruzioni con cui è stato “addestrato”. La svolta degli ultimi anni è che questi strumenti sono usciti dai reparti di ricerca e sviluppo e sono diventati prodotti di massa.

La situazione nel mondo

La parte più visibile di questa rivoluzione è forse la gara tra prodotti dei colossi del tech: ChatGPT (OpenAI), Gemini (Google), Claude (Anthropic) e Copilot (Microsoft) competono su qualità delle risposte e integrazione con app e software di lavoro; per usi meno “professionali” ci sono le AI di Meta e il famigerato Grok, il chatbot della piattaforma X (ex Twitter) che prova a differenziarsi proprio grazie a questa collocazione “dentro” il flusso social.

Sotto la superficie c’è un secondo binario, quello dell’infrastruttura: chip, data center, cloud e accesso all’energia. Qui la posta in gioco non è solo tecnologica, ma (macro) industriale, anche perché quanto più i modelli diventano sofisticati e “operativi” – cioè capaci di eseguire compiti in sequenza sempre più complessi – la potenza di calcolo richiesta tende a salire.

Il terzo binario è la governance. Le analisi più autorevoli concordano su un punto: la diffusione dell’AI e del suo utilizzo è in rapida crescita, ma parallelamente cresce il bisogno di regole, controlli e trasparenza. Il report “AI Index 2025” dell’università di Stanford raccoglie indicatori su ricerca, investimenti e performance dei modelli, documentando un’innovazione sempre più rapida.

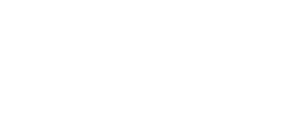

Anche l’OCSE, nel suo report dedicato agli investimenti in AI, mette in evidenza la concentrazione delle risorse in pochi poli globali. Nella sua analisi “The State of AI”, McKinsey descrive poi un passaggio cruciale: dall’AI come semplice esperimento alla sua diffusione come pratica organizzativa, con conseguenze molto concrete e talvolta problematiche (qualità dei dati, sicurezza, responsabilità, competenze).

La situazione in Italia

Anche per l’Italia la domanda ormai non è più “se” l’AI arriverà, ma “come” verrà governata e con quali basi. In questo senso, il rapporto della Commissione UE (2025 Digital Decade Country Report) dedicato all’Italia è utile perché misura il contesto, in particolare la diffusione di competenze digitali, infrastrutture e adozione di tecnologie avanzate. Da queste analisi risulta evidente come senza una gestione corretta di dati, cloud, sicurezza e formazione personale, l’AI rischia di rimanere “bloccata” al livello di una demo, senza generare un vero e proprio cambio di passo.

Un tema di cui si discute da tempo anche nelle istituzioni. Già due anni fa, in un Rapporto della Commissione Trasporti della Camera dei deputati (31 gennaio 2024) emerge un’idea di fondo: per usare l’IA servono capacità di valutazione, regole chiare e competenze interne, soprattutto nella Pubblica Amministrazione. In altre parole, non basta “comprare” un chatbot per avere una PA più efficiente: bisogna sapere cosa fanno questi software, su quali dati si basano, e soprattutto chi risponde quando sbagliano.

Nel frattempo, molte aziende in modo capillare e spontaneo, hanno ormai iniziato a utilizzare l’AI in modo strutturale, sia pure attraverso le sue varianti più semplici: strumenti di scrittura, ricerca, sintesi e traduzione che riducono il tempo speso su attività cognitive ripetitive e facilmente automatizzabili. È un approccio pragmatico, ma anche questo richiede metodo: verifiche, policy interne e formazione.

Cosa pensano gli italiani

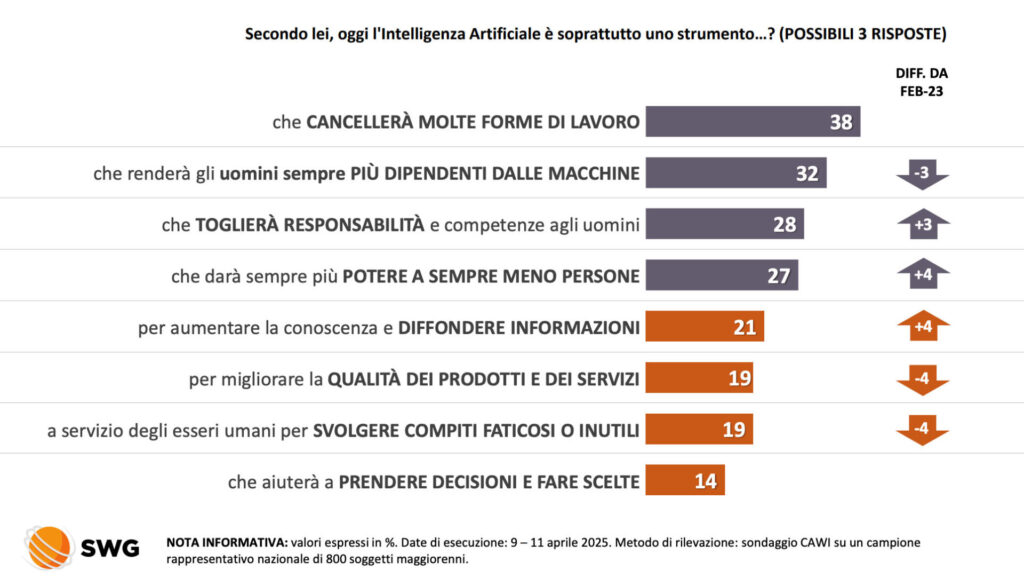

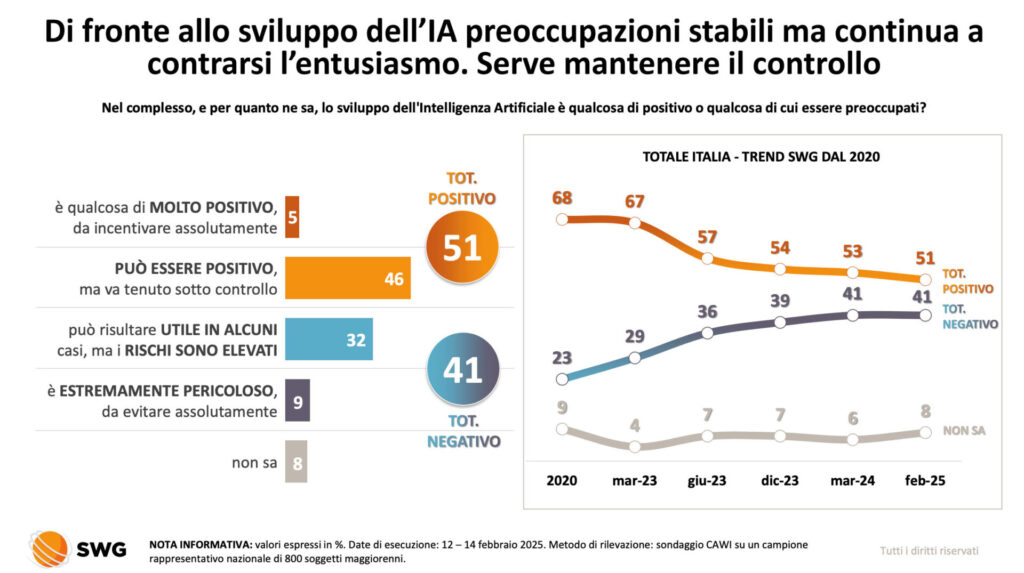

Ma come si pongono gli italiani rispetto a questa rivoluzione tecnologica e ai suoi sviluppi? Secondo una ricerca dell’istituto SWG di esattamente un anno fa (febbraio 2025) tra gli italiani prevale ancora un’opinione ottimistica nei confronti dell’AI (51%). Eppure, cresce la quota di chi ne vede soprattutto i rischi: 41%, con una crescita di ben 12 punti in due anni. Se vogliamo, una naturale conseguenza della diffusione di quella che prima era una novità e che si è trasformata gradualmente in presenza quotidiana: quando l’AI entra nei servizi, nel lavoro e nella scuola, chiediamo più garanzie.

Non a caso, sempre SWG rileva una preferenza netta per un approccio prudente e regolatorio (58%) che del resto è in linea con l’approccio generale dell’Unione Europea quando si parla di novità tecnologiche, ben diverso rispetto ai modelli regolatori di USA o Cina. Le preoccupazioni principali restano quelle legate al lavoro (38%), ma nello stesso sondaggio cambia la qualità dei timori: l’idea di dipendenza dalle macchine lascia spazio alla questione delle responsabilità umane. A spaventare non è più (solo) l’algoritmo, bensì l’assenza di controlli su chi lo progetta e chi lo usa.

Questi sondaggi fotografano anche un confine abbastanza chiaro: oggi rivendichiamo più autonomia decisionale e siamo meno favorevoli a farci assistere dall’AI nelle scelte più importanti.

In campo affettivo, etico, educativo e politico la netta maggioranza degli italiani non ama le ingerenze, mentre per quanto riguarda le sfere più pubbliche (in ambito giuridico ed economico) c’è una maggiore divisione, ma la tendenza è quella di una maggior chiusura rispetto al 2023. E poi c’è la pratica quotidiana, che spesso anticipa le opinioni: l’esperienza degli utenti sta diventando più “utilitaristica”, come conferma il 36% che dichiara di usare ChatGPT per aumentare la produttività lavorativa.

Interessante, infine, l’orientamento dei dirigenti della PA rilevato da un’indagine apposita: quasi 4 su 5 vedono l’AI come un’opportunità, per guadagnare tempo su attività complesse e semplificare processi. È una buona notizia, a patto che l’opportunità non diventi scorciatoia: soprattutto perché (a differenza che nelle aziende private) nella PA la qualità delle procedure e delle decisioni pesa quanto la velocità.

Una sfida di responsabilità

Il quadro, dunque, è meno “fantascientifico” e molto più “umano” di quanto sembri. Nel mondo l’AI corre su tre binari – prodotti, infrastrutture, regole – non necessariamente paralleli, come dimostrano le differenze di approccio tra l’Europa e altri colossi geopolitici come USA e Cina. In Italia, assente l’aspetto puramente industriale, il tema è più di carattere infrastrutturale e soprattutto regolatorio, il che chiama necessariamente in causa un coordinamento in sede UE. Ma con un’opinione pubblica che, nonostante i timori crescenti, resta in maggioranza ottimista, ci sono margini per un intervento equilibrato, che non assecondi i timori dei catastrofisti ma che tenga conto del potenziale dirompente di questa nuova tecnologia, soprattutto per ciò che riguarda gli equilibri nel mondo del lavoro.

Forse la domanda decisiva a cui dobbiamo rispondere non è se l’intelligenza artificiale sia “buona” o “cattiva”, bensì se l’intelligenza naturale umana sarà in grado di usarla come uno strumento allo stesso tempo potente e fallibile, con responsabilità tracciabili, senza trasformarla né in un oracolo a cui delegare tutto, né in uno spauracchio da cui fuggire.