(articolo di Eleonora Boin, da VicenzaPiù Viva n. 305, sul web per gli abbonati tutti i numeri, ndr)

Il 2025 è stato sicuramente l’anno del boom dell’intelligenza artificiale, come confermato dal giornale americano Time, che ha dichiarato l’IA e i suoi architetti persona dell’anno. Infatti, se fino agli anni scorsi era rimasta una tecnologia di nicchia e poco potente, ultimamente si è trasformata in una vera e propria infrastruttura diffusa, utilizzata in settori sempre più ampi: dalla selezione del personale alla diagnosi medica, dai sistemi di sorveglianza ai modelli in grado di generare testi, immagini e video. Un utilizzo sempre maggiore sia a livello aziendale che personale, che ne ha decretato la rilevanza ormai assoluta all’interno della nostra società. Una diffusione rapida e totale, che ha posto ai governi un problema ormai centrale: come regolare una tecnologia che permette benefici economici e sociali importanti, ma che rischia di produrre discriminazioni, violazioni della privacy, dei diritti d’autore e nuove forme di controllo sociale?

L’Unione europea ha risposto a questa domanda con un regolamento, ovvero uno di quegli atti giuridici dell’Ue che vale automaticamente in tutti gli stati membri. Parliamo dell’AI Act (dall’inglese Artificial Intelligence Act), ovvero il primo regolamento al mondo pensato per disciplinare in modo organico l’uso e lo sviluppo dell’intelligenza artificiale.

L’AI Act è stato approvato definitivamente nel 2024 dopo oltre tre anni di negoziati ed entrerà in vigore in modo graduale tra il 2025 e il 2026.

Questo regolamento è solo l’ultimo di una serie di atti volti a regolamentare lo spazio digitale voluti dall’ex commissario al mercato interno Thierry Breton. Negli ultimi anni l’Ue ha costruito un vero e proprio impianto normativo sul digitale, che comprende il GDPR sulla protezione dei dati personali, il Digital Services Act sulla responsabilità delle piattaforme online, il Digital Markets Act sulla concorrenza nei mercati digitali, il Data Act sulla circolazione dei dati e il Media Freedom Act, sulla libertà di informazione.

In questo contesto, l’IA viene quindi trattata come una tecnologia che va integrata all’interno di una legislazione ben precisa in materia di digitale, che va adeguata essa stessa in un ecosistema basato sui principi europei di tutela dei diritti, concorrenza e sicurezza dei consumatori/cittadini.

Un regolamento basato sul rischio

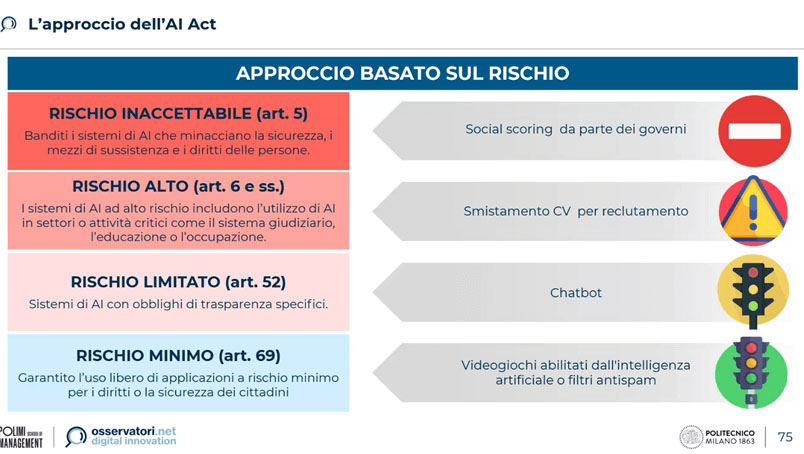

L’impianto dell’AI Act si basa sulla classificazione del rischio, dividendo di fatto i sistemi IA in quattro livelli differenti in base al potenziale impatto che possono avere sulle persone e sulla società.

Il primo livello è quello a rischio più alto, ovvero tutti quei sistemi considerati un “rischio inaccettabile” e che quindi vengono vietati in modo esplicito. Ne fanno parte tutti i sistemi di manipolazione comportamentale che sfruttano vulnerabilità psicologiche, i meccanismi di social scoring dei cittadini e alcune forme di sorveglianza biometrica di massa. Ad esempio, negli spazi pubblici dell’Ue è esplicitamente vietato l’utilizzo del riconoscimento facciale in tempo reale, salvo eccezioni molto limitate legate alla sicurezza nazionale, cosa che non si può dire in altri paesi, come ad esempio la Cina o l’Iran, dotati di telecamere nelle strade che di fatto controllano i cittadini. Questo divieto assoluto di utilizzare questi sistemi deriva dalla logica che essi siano incompatibili con i valori fondamentali dell’Ue e non possano essere legittimate nemmeno da possibili benefici.

Il secondo livello riguarda i sistemi di IA ad “alto rischio”, che non sono vietati in assoluto, ma vengono sottoposti a un regime di controllo rigoroso. Si tratta di tutti i sistemi IA utilizzati in specifici settori considerati delicati, come la sanità, l’istruzione, la selezione del personale, l’accesso al credito, la giustizia, il controllo delle frontiere o la gestione di infrastrutture critiche.

L’AI Act prevede una serie di obblighi in questi casi, tra cui una valutazione preventiva dei rischi, la qualità e rappresentatività dei dati di addestramento, che le decisioni prese dall’IA siano tracciabili, che vengano opportunamente documentati i dettagli tecnici e, infine, la presenza di supervisione umana. L’obiettivo è ridurre il rischio di errori sistemici, discriminazioni automatizzate e decisioni opache difficili da contestare, per non lasciare che i bias umani trasportati dai programmatori ai software decidano chi ha il diritto di ottenere una casa famiglia o un trapianto di cuore.

Ci sono poi i cosiddetti sistemi a “rischio limitato”, che sostanzialmente sono solo soggetti a obblighi di trasparenza, come nel caso dei chatbot o dei sistemi di generazione di contenuti, che devono rendere evidente che gli utenti stanno interagendo con un’IA, ma anche quando un testo, un’immagine o un video sono stati prodotti artificialmente. Perché alla fine, il problema non è tanto l’esistenza di queste tecnologie, quanto il loro utilizzo senza consapevolezza da parte delle persone che non riescono a riconoscere che il video di un gatto sugli sci non è reale.

Tutto ciò che non rientra in queste categorie viene classificato come a “rischio minimo” e non è soggetto a nuovi obblighi specifici. Questa categoria rappresenta una parte consistente dell’intelligenza artificiale che esiste oggi e serve a evitare che il regolamento diventi un freno generalizzato all’innovazione.

Il nodo dell’intelligenza artificiale generativa

Uno degli aspetti più complessi del negoziato sull’AI Act sono stati i modelli di intelligenza artificiale per finalità generali, come quelli alla base dei sistemi di IA generativa. Quando la proposta iniziale della Commissione fu presentata nel 2021, questi strumenti non erano ancora diffusi come oggi e soprattutto non erano così potenti. La rapida affermazione dei grandi modelli linguistici ha costretto le istituzioni europee a intervenire, e così nel testo finale sono stati introdotti obblighi specifici per questi modelli, soprattutto in termini di trasparenza. Tra le altre cose, le aziende che li producono devono dichiarare quali dati sono stati utilizzati per l’addestramento e adottare misure per rispettare il diritto d’autore. Per i modelli più potenti, considerati di “impatto sistemico” e quindi potenzialmente in grado di influenzare il mercato o il dibattito pubblico, sono previsti requisiti aggiuntivi di sicurezza e valutazione dei rischi.

Sanzioni, controlli e applicazione

Il sistema di sanzioni previsto dall’AI Act è simile a quello del GDPR e di altri regolamenti europei: le violazioni più gravi, come l’uso di pratiche vietate, possono essere punite con multe fino a 35 milioni di euro o al 7% del fatturato globale annuo dell’azienda. Le sanzioni diminuiscono per gli obblighi meno rilevanti, ma restano comunque elevate. L’applicazione del regolamento sarà affidata alle singole nazioni, che verranno coordinate a livello europeo da un nuovo Ufficio per l’IA istituito presso la Commissione, un modello di governance che cerca di bilanciare l’armonizzazione del mercato unico con le competenze degli Stati membri, ma che potrebbe creare differenze nell’applicazione pratica delle regole.

Tra tutela dei diritti e timori per l’innovazione

Politicamente, l’AI Act rappresenta una scelta chiara: l’Ue ha deciso di intervenire prima che l’intelligenza artificiale diventi completamente pervasiva, fissando regole comuni in anticipo. Le istituzioni europee lo presentano come un modello di IA affidabile e centrata sull’essere umano. C’è però da dire che questo regolamento si inserisce in un contesto, quello europeo, in cui ci sono poche aziende che producono intelligenza artificiale e per questo è stato bollato da alcuni come inutile e dannoso per la competitività del continente, insomma, un altro problema burocratico voluto da Bruxelles. Molte startup e investitori sostengono che il regolamento rischi di favorire i grandi gruppi tecnologici (perlopiù americani), più attrezzati per sostenere i costi di conformità e anche tra gli Stati membri sono emerse divisioni, soprattutto sul grado di regolazione dei modelli di base.

Nonostante tutto, l’AI Act rimane un passaggio importante nella storia della regolazione tecnologica e, come accaduto con il GDPR e gli altri regolamenti dello spazio digitale, il suo impatto andrà probabilmente oltre i confini europei, dato che anche i colossi americani e cinesi dovranno adeguarsi agli standard dell’Ue per operare nel nostro mercato.